1. 서론

1.1 연구의 배경 및 목적

1.2 연구의 범위 및 방법

2. 방법론

2.1 구조 안전성 모니터링과 외관 조사

2.2 UAV, 컴퓨터 비전 기반 외관 조사

2.3 UAV, BIM 기반 위치 측정 방법

3. 실험 결과

3.1 실험 구성

3.2 실험 결과 및 오차 원인

3.3 오차 보정

4. 결론 및 향후 연구

1. 서론

1.1 연구의 배경 및 목적

우리나라의 경제적 성장에 따라 많은 건축 시설물, 토목 시설물들이 생겨났고, 이제는 여러 시설물의 생애주기가 내구연한이 도래함에 따라 유지관리 수요가 증가하고 있으며 가까운 미래에도 꾸준히 증가할 것으로 전망되고 있다. 시설물의 설계 성능은 시간이 흐름에 따라 저하되고, 이를 적절히 관리하지 못하면 시설물의 성능이 요구 성능에 미치지 못할 정도로 저하되어 안전사고로 이어질 수 있다. 안전사고를 예방하고, 나아가 내구연한을 시설물 준공 시 목표했던 시기 이상으로 유지하고, 더 나아가 이를 연장하여 시설물을 오랜 기간 사용할 수 있도록 적절한 보수와 보강을 통해 시설물의 기능을 보전해야 한다. 이를 위해서는 반드시 구조물 외관 조사 등의 시설물 안점 점검이 필요하다. 안전 점검을 통해 시설물의 기능과 성능이 잘 유지되고 있는지 파악해야만 적절한 보수와 보강 계획을 수립할 수 있기 때문이다. 이와 더불어 최근의 탄소 및 에너지 절감 등의 환경 보호 수요에 따라 시설물의 유지관리에 대한 수요가 날이 갈수록 높아지고 있다.

위에서 언급한 바와 같이 시설물 유지관리에 있어 안전 점검은 핵심적인 요소이다. 국토교통부에서 정한 시설물 유지관리 실시 세부 지침에 따르면 안전 점검은 적절한 경험과 기술을 보유한 자가 육안이나 점검 기구 등으로 검사하여 시설물에 내재 되어 있는 위험 요인을 조사하는 행위를 의미한다. 외관 조사는 시설물 표면에 발생한 결함, 손상을 파악할 수 있는 수단으로써 안전 점검에서 필수적으로 요구되는 현장 조사 과정 중의 하나다. 구조물의 표면에 발생한 손상을 조사하여 손상의 종류, 크기 그리고 위치 등을 파악하여 구조물의 상태변화를 확인할 수 있다. 구조물의 부적절한 상태변화는 안전사고로 이어질 수 있는 중대한 위험 요인이기 때문에 구조물의 안전 유지를 위해서는 지속적인 외관 조사가 요구된다.

시설물 유지관리 수요 증가에 따라 효율적이고 신뢰도 높은 유지관리를 위해 자동화, 전산화 필요성도 함께 증가하고 있다. 최근에는 이러한 요구에 따라 ICT (Information and Communication Technology), 빅데이터, 로봇, 인공지능 등의 첨단 기술들을 활용한 스마트 유지관리 기술들이 선보이고 있다. BIM (Building Information Modeling) 기술과 UAV (Unmanned Aerial Vehicle) 기반 점검 기술은 안전 점검, 특히 외관 조사에 있어 핵심적인 기술들이다.

BIM은 구조물의 각종 정보를 담고 있는 통합 정보 모델로, 점검 정보들 또한 함께 관리할 수 있는 효율적인 플랫폼이다. 안전 점검 과정이 자동화, 전산화되어 디지털화된 정보로 생성될 때, 이를 연동하여 관리하기에 효율성을 높일 수 있다. 예를 들면 현재는 도면 형식으로 작성되고 관리되고 있는 외관조사망도와 같은 문서들이 3D 형상 정보와 연계되어 모델의 텍스쳐(Texture) 형식으로 저장되어 관리될 수 있다. 이러한 편의성으로 인해 유지관리에 개입하고 있는 시설물 운영자들이 직관적으로 시각화된 점검 정보를 확인할 수 있어, 훨씬 더 효율적인 안전 점검, 유지관리를 가능케 할 수 있다. 최근에는 시설물 BIM에 대한 제도들이 차차 마련되고 있어 수요와 활용도가 높아지고 있다.

UAV는 위치 이동이 자유롭다는 것이 가장 큰 장점이다. 외관 조사의 대부분은 육안 검사를 기반으로 진행되고 있기 때문에 검사자의 주관이 개입될 가능성이 높고, 검사 결과의 객관성을 확보하기가 어렵다는 한계가 있다. 작업 과정의 특성상 인력에 의존적이고, 이에 따라 많은 비용과 시간이 소요된다. 또한, 시설물 전체를 대상으로 하는 외관 조사의 경우에는 구조체 벽면, 교량 하부 등 조사자가 도보로 접근하기 어려운 위치가 대상인 경우들이 있는데 이러한 위치는 사다리차 등의 특수 장비를 필요로 하기도 하고, 낙상 사고와 같은 안전사고의 위험에 노출되는 것이 사실이다(Dorafshan and Maguire, 2018). 이런 환경에서 UAV를 활용한다면 안전, 비용 등의 문제를 개선할 수 있다. 뿐만 아니라 손상 탐지, 손상 위치 측정 과정의 자동화를 통해 기존의 방법보다 객관성을 확보하기가 수월하다. 더 나아가 완전 무인 기반의 자동화된 점검 체계를 갖추게 된다면 시간에 구애받지 않고 지속적인 시설물 안전 점검이 가능해져 지속적인 모니터링에 한계가 있는 기존의 외관 조사 방법의 한계를 보완할 수 있을 것으로 기대할 수 있다.

이렇듯 UAV와 BIM은 유지관리에 있어서 각각 정보 생산, 정보 관리 측면에서 활용 가치가 높은 기술들이다. 이 두 기술을 활용한다면 훨씬 더 안전하고 효율적인 외관 조사가 가능해질 것이다. 이러한 목적으로 여러 연구들이 진행되었다. 하지만 대부분의 연구들은 외관 손상 탐지 및 기록 과정에서 대상 구조물 전체를 대상으로 하는 3D 스캔 기반 방식을 활용하고 있으며 국소 영역에 대한 외관 손상 탐지 및 기록 방법에 대해 다루고 있는 연구들은 비교적 많지 않은 편이다(Tian et al., 2022).

본 연구에서 소개하는 UAV/BIM 기반 손상 측위 방법은 UAV를 활용한 외관 조사 과정에서 탐지된 외관 손상의 위치를 기록하기 위해 필요한 외관 손상의 공간 좌표를 추정하는 방법이다. 이 방법을 적용하면 구조물 전체 혹은 넓은 영역에 대한 스캔 없이, 국소 영역을 대상으로 촬영한 단일 사진 혹은 영상으로부터 외관 손상의 위치를 추정할 수 있으므로 전체 시설물에 대한 3D 스캔이 필요하지 않다. 또한, 거리측정기와 같은 별도의 센서, GCP (Ground Control Point) 관리 없이도 수행할 수 있다. 추정된 3D 공간 좌표를 이용해 손상의 위치를 외관조사망도나 BIM 데이터와 연동하는 데에 활용될 수 있다.

1.2 연구의 범위 및 방법

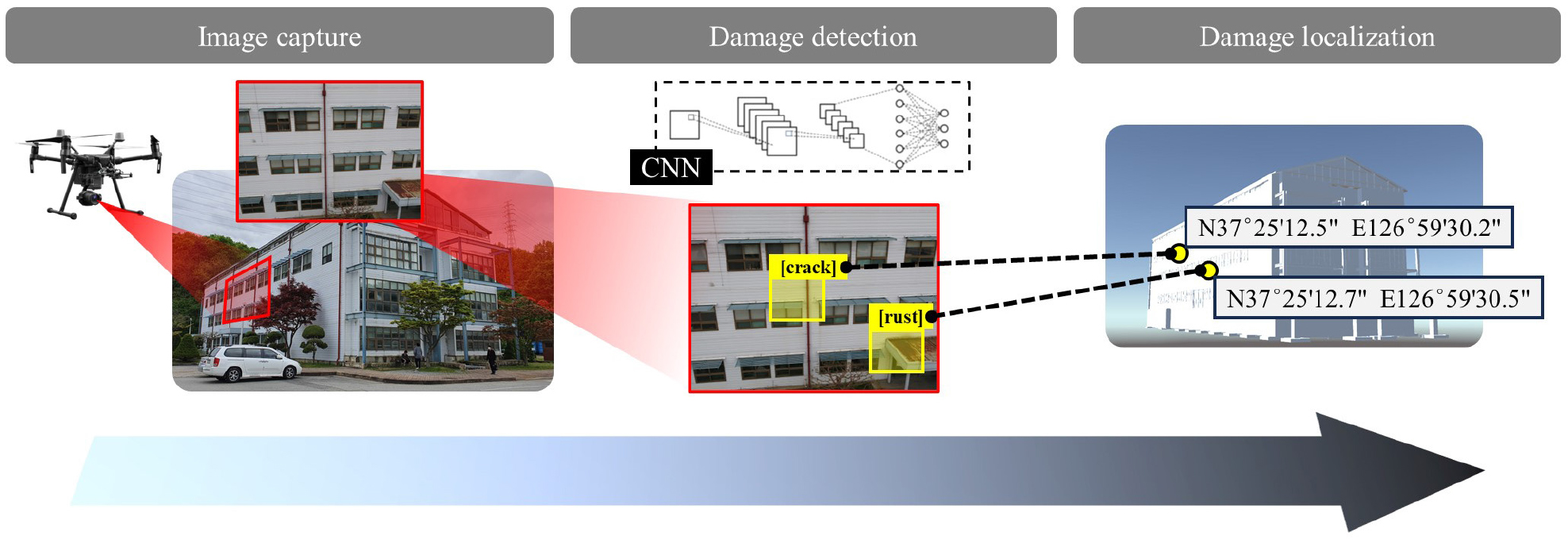

본 연구에서 소개하는 UAV/BIM 기반 손상 측위 방법은 UAV와 컴퓨터 비전 기술(Computer vision)을 활용한 외관 조사 방법에 적용될 수 있는 측위 방법이다. UAV와 컴퓨터 비전 기술을 활용한 외관 조사 방법의 전반적인 흐름은 Figure 1과 같다.

UAV와 UAV에 탑재된 카메라를 통해 외관 조사 대상 구조물의 외관 탐색을 실시한다.

획득한 이미지 데이터에 CNN (Convolutional Neural Network) 기반의 손상 탐지 알고리즘을 적용하여 균열, 박리, 박락 등의 외관 손상을 탐지한다. 탐지된 외관 손상은 이미지의 픽셀(Pixel) 영역으로 표현된다.

손상에 해당하는 픽셀 좌표로부터 실제 3D 공간 좌표를 추정한다. 이때, UAV에 탑재된 각종 센서 데이터와 사진, 영상의 메타데이터가 계산에 활용된다.

계산된 외관 손상의 3D 좌표를 외관 조사망도, BIM에 기록한다.

UAV/BIM 기반 손상 측위 방법은 이 중에서 세 번째, 외관 손상의 측위 과정에 적용될 수 있다. 수집된 이미지 데이터에서 탐지된 외관 손상의 2D 이미지 좌표로부터 3D 공간 좌표를 추정하는 과정이다. 따라서, 탐지된 외관 손상의 2D 이미지 좌표가 필요한데 본 연구에서는 컴퓨터 비전 알고리즘을 통해 외관 손상이 성공적으로 탐지되었음을 가정하고 연구가 진행되었다.

연구 가설의 검증은 실험을 통해 이루어졌다. 본 연구에서 제안하는 방법은 BIM, 특히 3D 모델이 필요하기 때문에 BIM 모델을 확보할 수 있는 건축 구조물을 목표로 선정했다. 목표 구조물에 대해 본 연구에서 제안하는 UAV/BIM 기반 외관 손상 측위 방법을 적용하여 외관 손상의 위치를 계산하여 추정했고, 추정된 결과를 실측 결과와 비교하여 위치 정확도를 확인했다.

2. 방법론

2.1 구조 안전성 모니터링과 외관 조사

시설물 유지관리를 위한 안전 점검 방법은 크게 구조 안전성 모니터링(Structural health monitoring)과 외관 조사(Visual inspection) 방법 두 가지로 나누어 볼 수 있다. 구조 안전성 모니터링과 외관 조사는 뚜렷한 특성 차이가 있지만 전체적인 기능은 상호 배타적이지 않으며 둘 간의 기능적 차이를 활용해 보완함으로써 더 효과적으로 시설물 안전 유지 목적을 달성할 수 있다(Agdas et al., 2016).

전통적인 구조 안전성 모니터링 방법은 구조물의 거동, 즉 진동이나 변형을 탐지하는 것이 핵심이기 때문에 이러한 물리적 움직임을 파악할 수 있는 다양한 센서들을 기반으로 이루어진다. 스트레인 게이지, 가속도계와 같은 센서들은 구조물의 거동 파악을 위해 가장 널리 사용되는 센서들이다. 이외에도 GNSS (Global Navigation Satellite System), 레이더, 레이저, 카메라 등의 센서들이 활용되기도 한다(Lim et al., 2011; Lim et al., 2014; Liu et al., 2020). 최근에는 ICT 기술들과 융합하여 무선으로 데이터들을 수집하고 방대한 데이터를 기반으로 하여 모니터링을 수행하기도 한다(Kim et al., 2018; Saleem et al., 2021; Zhao et al., 2022). 하지만, 많은 경우들에 있어서 구조물의 거동을 파악하는 것만으로는 시설물의 안전을 유지하기에 부족할 수 있으며 구조물에 발생한 손상을 직접적으로 탐지하고, 기록하는 것이 필요할 수 있다.

외관 조사를 통해 센서만으로는 탐지할 수 없거나 탐지하기가 매우 어려운 부식, 박리, 박락과 같은 외부적 결함 및 손상들에 대해 파악할 수 있으며 손상의 범위와 심각성을 평가하여 구조물의 전체적인 상태 평가가 가능하기 때문에 전통적인 구조 안전성 모니터링 방법의 부족한 부분을 보완할 수 있다. 하지만 인력에 의존적인 기존 외관 조사 방법의 특성상 조사자의 주관이 개입될 가능성이 크고, 조사 결과의 객관성을 확보하기가 어렵다는 한계가 있다. 또한, 교량 하부와 같이 높은 위치에서의 작업에 따른 낙상사고, 낙하물 사고 등의 안전사고 발생 위험이 있다. 조사 속도에도 한계가 있어 목표 구조물의 규모가 커지면 조사를 완료하기까지 훨씬 더 많은 시간이 소요된다. 이런 이유들로 인해 높은 빈도의 외관 조사를 진행하기에는 어려움이 있기 때문에 외관 손상 정보의 추적 관찰, 최신화에 있어 한계가 있다.

2.2 UAV, 컴퓨터 비전 기반 외관 조사

UAV와 컴퓨터 비전(Computer vision) 기술을 활용하면 인력에 대한 의존도를 낮출 수 있어 기존의 외관 조사 방법이 지닌 한계들을 극복하고 보완할 수 있다. 특히, 외관 조사의 완전 자동화를 달성할 수 있다면 기존보다 훨씬 더 저렴한 비용으로 높은 빈도의 외관 조사가 가능해질 수 있다. 이런 이유로 외관 조사의 자동화, 전산화, 효율화를 목표로 하여 UAV와 컴퓨터 비전을 활용한 외관 조사 방법에 대한 다양한 연구들이 진행됐다.

가장 널리 사용되고 있는 기술은 3D 스캔(Scan) 혹은 재구성(Reconstruction)이라 불리는 SfM (Structure from Motion) 기반의 방식들이다. 카메라를 통해 획득한 이미지 데이터만으로 목표 구조물의 전체적인 형상 정보를 획득할 수 있는 방식이다. Zhao et al. (2022)의 연구는 SfM 방식을 활용한 주요 사례 중 하나다. UAV에 탑재된 카메라를 이용하여 콘크리트 댐을 대상으로 이미지 촬영을 진행했다. 촬영된 이미지에 YOLOv5 CNN 알고리즘을 활용하여 손상을 탐지하여 표시했고, 해당 이미지들을 SfM 방식으로 3D 재구성하여 탐지된 손상이 표시된 구조물의 3D 형상 정보를 획득할 수 있었다. Kim et al. (2018)은 오래된 교량을 대상으로 CNN 기반 알고리즘을 통해 균열을 탐지하고, 3D 포인트 클라우드(Point cloud) 모델에 균열의 위치를 표시했다. 이 과정에서 UAV와 목표물 표면까지의 거리를 추정하기 위해 2D 마커를 사용하였으며 이를 탐지하여 위치와 깊이 정보를 대신했다.

하지만 이런 방식들은 3D 재구성을 위해 다량의 이미지가 필요하며 이것은 데이터양과 연산량이 많고 그만큼 데이터 획득과 연산 과정에 필요한 시간이 매우 길어진다는 것을 의미한다. 다량의 이미지를 서로 이어 붙이는 방식이기 때문에 이미지 안에서 공통된 부분을 찾기 위한 특징점 추출 및 매칭 과정이 반드시 필요한데, 반복 패턴 형태의 구조물을 대상으로 하거나 특징점을 찾아보기 어려울 정도로 편평한 구조물을 대상으로 한 경우에는 충분한 밀도의 특징점 확보가 어려울 수 있다. 특히, 작은 크기의 손상을 탐지하거나 손상 정도를 정확하게 판정하기 위해 근접 촬영이 필요한 경우에는 이러한 문제가 더욱 두드러지게 나타난다. 정확도를 높이기 위해 GCP와 2D 마커 같은 기지점이 활용되기도 하는데 적절하지 못한 화각이나 근접에서 촬영되면 이 기지점들이 이미지 내에 제대로 표기되지 않는다는 문제 또한 가지고 있다. 부가적으로 이것들을 설치하고 유지, 관리하기 위한 노력도 필요하며 특히나 이 과정은 현재로서는 자동화할 수 없는 영역이다. 또한, 대상 영역 전체를 골고루 촬영할 수 있도록 적절한 비행 계획 또한 필요하다. 이런 특성들로 인해 국소 영역에 대한 조사가 필요한 경우에는 적합하지 않을 수 있다.

단일 이미지 사진측량(Single image photogrammetry) 방식은 국소 영역에 대한 조사가 필요한 경우에 적합한 방식 중 하나다. 이 방식은 3D 재구성 방식에 비해 정확도와 정밀도 측면에서 제한이 있을 수 있지만 한 장의 이미지만으로 측정이 가능하기 때문에 측정 과정을 훨씬 간소화할 수 있으며 특히 특징점 추출 및 매칭 문제에서 자유롭기 때문에 근접 촬영에 있어서는 효과적인 절충안이 될 수 있다. 기본적으로 이미지 좌표로부터 3D 공간 좌표를 추정하기 위해서는 깊이 정보가 필요하다. 따라서, 거리를 측정할 수 있는 레이저 거리측정기나 깊이 카메라(Depth camera)와 같은 장비들이 이러한 목적으로 주로 활용된다. Maria et al. (2005)은 레이저 거리측정기를 이용하여 카메라에서 물체까지의 거리를 측정하여 이미지 중심 좌표를 추정하는 방법을 제안했다. Martinez et al. (2011)은 위와 비슷한 방법으로 구조물의 표면의 3D 모델을 생성할 수 있는 측량 시스템을 개발했다. 이러한 방법을 구조물의 외관 조사를 목적으로 UAV에 활용한 연구들 또한 최근에 진행된 바 있다. Saleem et al. (2021)은 UAV에 탑재된 카메라의 GNSS, IMU, 거리측정기 데이터들을 활용하여 이미지 좌표로부터 3D 공간 좌표를 계산하고, 이를 통해 손상 지도를 작성하는 방법을 제안했다. Yoon et al. (2021)은 국소 영역에 대한 외관 조사를 목적으로 단일 이미지 사진측량 기반의 방식을 이용해 이미지 좌표로부터 3D 공간 좌표를 계산하는 방법을 제안했으며 이 연구에서도 GNSS, IMU, 거리측정기 데이터가 계산에 사용되었다. 단일 이미지 사진측량 방식에서 카메라의 위치 및 자세 정보 외에도 깊이 정보가 필요하므로 레이저 거리측정기와 같은 측정 장비들이 활용되었다. 하지만 UAV에 거리측정기를 장착하게 되면 카메라와 거리측정기 간의 캘리브레이션을 통해 변환 관계를 파악해야만 한다. 추가적인 장비 탑재로 인해 UAV의 비행 효율에 영향이 발생할 수 있으며 이것을 탑재하고 관리하는 데에 있어 비용이 소요된다.

이러한 이유로 이 과정을 더 간소화, 경량화하는 것이 본 연구에서 제안하는 UAV/BIM 기반 손상 측위 방법의 목표이다. 본 연구에서는 단일 이미지 사진측량 방식에 필요한 연산 과정에서 가상 공간과 BIM 모델을 활용한다. 이 경우, 거리 정보 획득을 위한 별도의 센서 탑재가 필요하지 않기 때문에 센서 탑재에 따른 비용과 캘리브레이션 과정 등의 과정을 생략할 수 있다.

2.3 UAV, BIM 기반 위치 측정 방법

UAV/BIM 기반 손상 측위 방법은 구조물 외관에 발생한 손상의 위치를 측정하는 방법으로, 먼저 외관 손상 탐지 과정이 선행되어야 한다. 하지만 본 연구의 범위는 손상 탐지는 포함하지 않으며 위치 측정만을 대상으로 한다. 따라서, 손상 탐지 과정은 목표 구조물 외관에 가상의 손상이 발생했으며 이 손상들을 모두 성공적으로 탐지했음을 가정하고 연구를 진행했다. 탐지된 외관 손상의 2D 픽셀 좌표로부터 3D 공간 좌표를 추정하는 과정에서 단일 이미지 사진측량 기반의 방식이 아닌 BIM 모델을 활용하는 새로운 방식을 제안한다. 획득한 데이터를 토대로 UAV에 장착된 카메라와 목표 구조물을 가상 공간에 배치하여 장면을 재구성하고, 가상 카메라와 가상 구조물의 위치 관계, 이미지와 구조물 표면의 기하 관계를 이용하여 최종 위치를 계산하는 방식이다.

2.3.1 가상 공간을 활용한 장면 재구성

외관 손상 데이터 획득 과정에서 UAV는 기체에 탑재된 카메라의 GNSS와 IMU 데이터를 이미지와 함께 메타데이터로 저장한다. 이 정보들과 목표 구조물의 BIM 모델에서 가져온 형상 정보를 활용해 이미지 촬영 당시, 카메라와 구조물의 상대적 위치 관계를 가상 공간에서 재구성하고, 이 관계를 활용하여 목표 지점의 3D 공간 좌표를 추정할 수 있다. UAV의 GNSS, IMU 데이터로부터 이미지 촬영 당시 카메라의 위치 및 자세를 계산할 수 있으며 이 정보들은 가상 공간에서 장면 재구성에 사용된다. 재구성 과정에서 가장 먼저 가상 구조물이 배치된다. 가상 구조물의 형태는 실제 구조물의 BIM 형상 정보를 사용하여 구성하기 때문에 실제 구조물의 형태를 반영할 수 있다. BIM에 담겨 있는 위치 정보를 활용하여 구조물을 가상 공간에 배치할 수 있다. 가상 카메라는 실제 UAV의 GNSS, IMU를 통해 획득한 위치 및 자세 정보를 토대로 재구성한다. UAV의 GNSS, IMU에서 수집한 데이터는 정확하게는 기체와 카메라에 대한 위치 및 자세 정보로 구분된다. 최종 위치 계산 과정에서 구조물 표면과 이미지 평면의 기하 관계를 활용하므로 카메라 중심 기준의 위치 및 자세 정보로 변환할 필요가 있다. 기체의 위치 정보는 기체에 장착된 GNSS를 통해 획득한다. 기체의 자세 정보는 비행 통제 장치 내의 IMU를 통해 획득하며 진북 방향을 기준으로 기체의 회전 정보를 나타낸다. 카메라의 회전 정보는 카메라가 장착된 짐벌(Gimbal)의 IMU를 통해 획득하며 기체의 머리 방향을 기준으로 카메라의 회전 정보를 나타낸다. 기체와 카메라의 위치 관계에 따라 카메라 중심 기준으로 위치 및 자세 정보를 변환하고, 이를 토대로 가상 공간에 가상 카메라를 재구성한다.

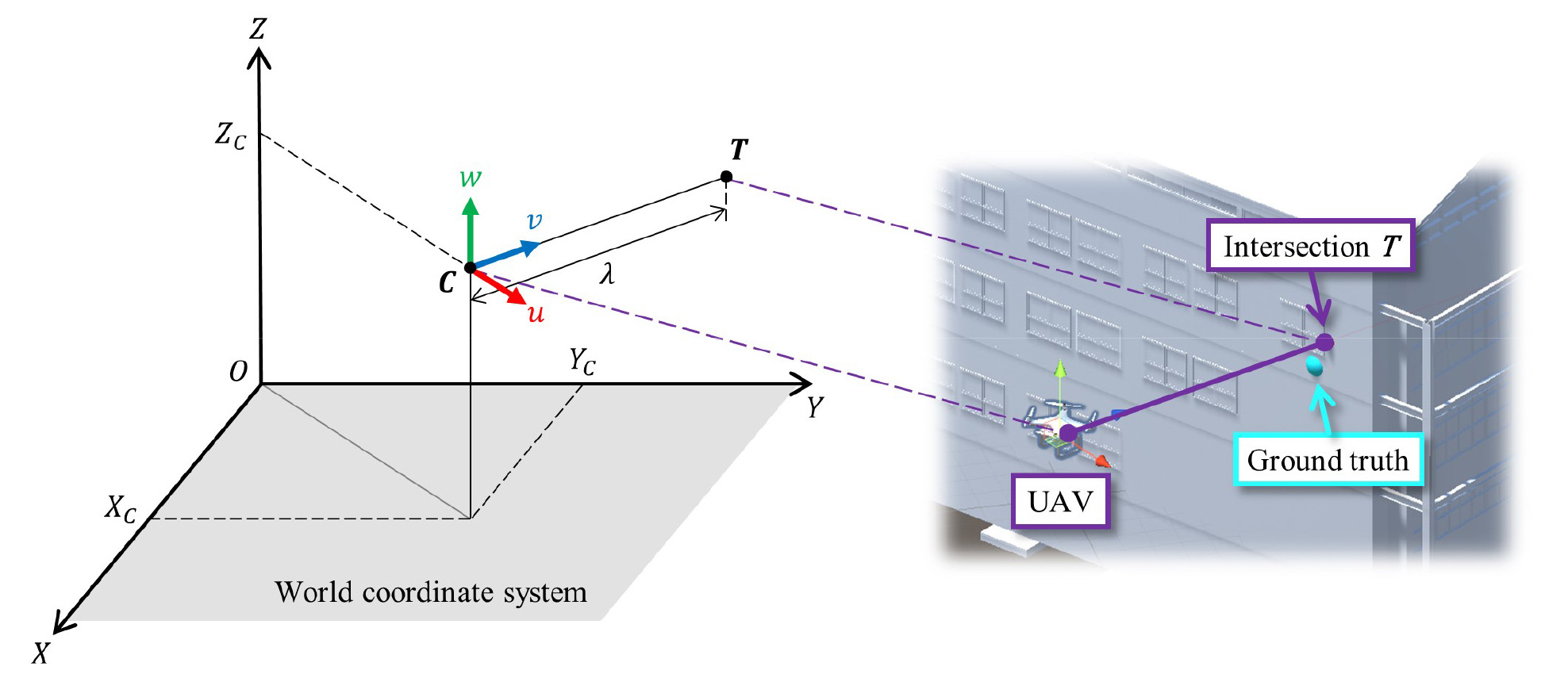

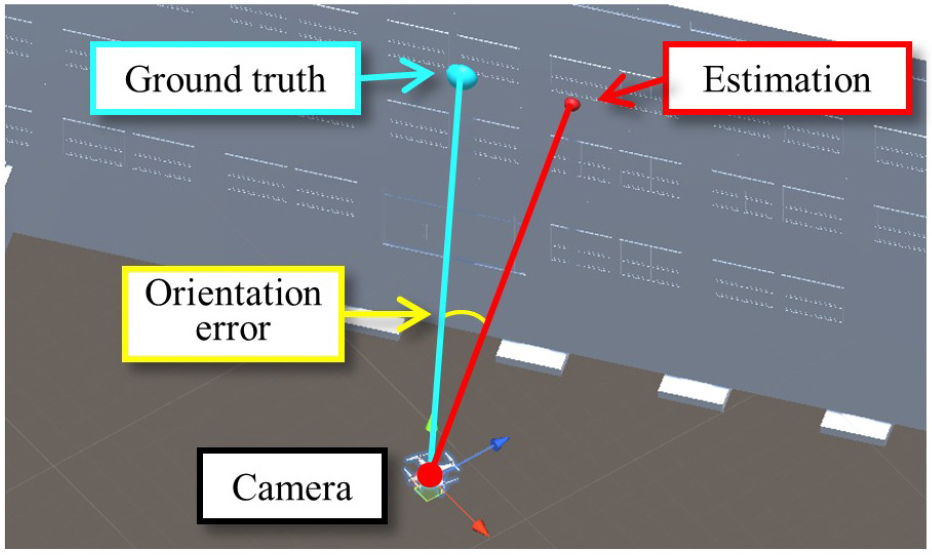

Figure 2는 가상 공간에 재구성된 장면에서 가상 카메라와 가상 구조물의 관계를 단순화하여 나타낸 것이다. 카메라 중심에 해당하는 C는 UAV를 통해 획득한 위치 정보를 토대로 (XC, YC, ZC)에 위치한다. 이때, 회전 정보에 따라 카메라 좌표계 (u, v, w)를 회전시킨다. 카메라가 향하는 방향은 v 축에 해당한다. v 방향으로 하나의 직선을 생성하면 직선상의 한 점에서 가상 구조물의 표면과 교차하게 된다. 이 교차점이 T에 해당하며 가상 공간상에서의 기하학적 상관관계를 이용하여 그 위치를 계산할 수 있다.

2.3.2 재구성 장면을 통한 위치 추정

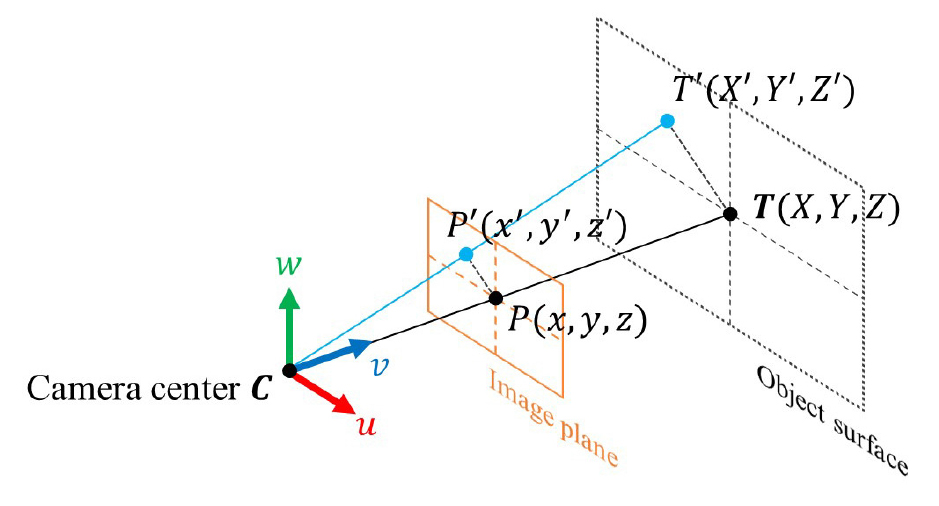

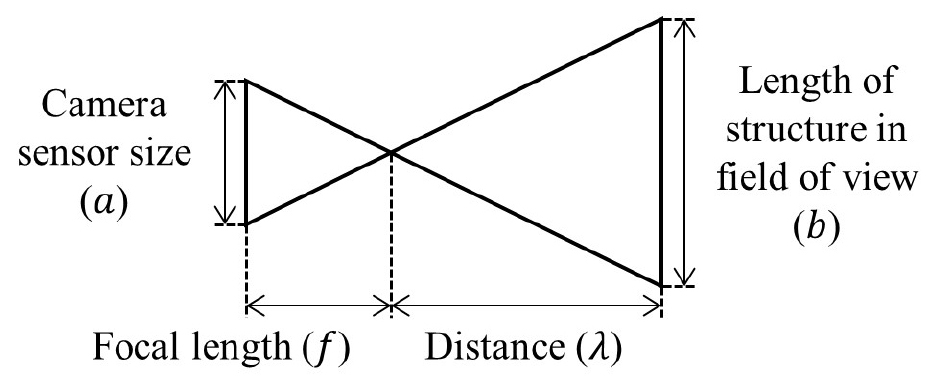

카메라 중심 C, 교차점 T의 관계를 이용하여 이미지 평면과 이미지 내에 투영된 구조물 표면의 관계는 주점 거리나 이미지 왜곡 등의 오차가 없다는 가정하에 삼각형 비례식에 따라 Figure 3과 같은 형태로 단순화할 수 있으며 수식 (1)의 관계를 만족한다.

여기서 b는 이미지 FOV (Field Of View) 내에 투영된 구조물 표면의 길이, λ는 카메라 중심 C와 교차점 T까지의 거리, f는 카메라의 초점거리, a는 이미지 센서의 크기를 의미한다. 이 관계를 이용하면 이미지 중심 좌표 외에도 이미지 내의 모든 좌표의 3D 공간 좌표를 추정할 수 있다(Yoon et al., 2021).

Figure 3.

Determining the FOV of the UAV according to the image sensor and working distance (Yoon et al., 2021)

이 관계에 따라 카메라 중심, 이미지 평면, FOV 내 구조물 표면의 관계는 다시 Figure 4와 같이 나타낼 수 있다. 먼저, 추정하고자 하는 위치가 이미지의 중심에 위치했다고 가정할 때, 카메라 중심 C와 이미지 중심 P가 이루는 벡터 CP가 가상 공간에 위치한 가상 구조물과 만나게 되는 교차점 T를 찾을 수 있다. 이 교차점의 3차원 좌표가 곧 추정하고자 하는 위치의 좌표이다. 만약 이미지 중심에서 벗어난 다른 위치에 해당하는 픽셀의 3차원 위치에 대한 계산이 필요한 경우에는 해당 영상 위치(P’)의 좌표를 이용하여 계산할 수 있다. 위에서와 같은 방법으로 카메라 중심 C와 좌표 P’이 이루는 벡터 CP’이 가상 공간에 위치한 가상 구조물과 만나게 되는 교차점 T`을 찾을 수 있다. P’은 촬영된 이미지 좌표 (x’, y’)와 카메라 초점거리에 해당하는 깊이 z’으로 표현될 수 있다. 본 연구에서는 디지털카메라를 사용했기 때문에 이미지 좌표는 픽셀 단위로 주어지게 된다. 픽셀 좌표는 이미지 센서의 크기에 따라 픽셀 피치(Pixel pitch)를 반영하여 길이 단위로 변환할 수 있다. 카메라 초점거리는 사용하는 카메라에 따라 달라질 수 있으나 초점이 변하지 않는 단초점 카메라를 가정하면 변하지 않는 상수이다. P’과 같이 이미지 중심에서 벗어난 위치의 이미지 좌표에 대한 계산이 필요한 이유는 모든 관측점이 항상 이미지 중심에 위치하지는 않기 때문이다. 하지만 이 경우, 이미지 왜곡에 따른 영향이 있을 수 있으며 카메라 캘리브레이션을 통해 추가적인 왜곡 보정 과정을 수행하지 않는다면 측정 위치가 이미지 중심에서 벗어날수록 오차가 커질 가능성이 높다.

3. 실험 결과

3.1 실험 구성

본 연구에서 제안하는 방법의 정확도를 확인하기 위해 건축 구조물을 대상으로 실험을 진행했다. 목표 구조물에 발생한 가상 손상의 위치를 TLS (Terrestrial Laser Scanner)로 실측했고, 이를 제안된 방법을 통해 계산된 결과와 비교하여 오차를 확인했다. 직관적인 비교를 위해 최종적으로 두 결과 모두 UTM (Universal Transverse Mercator) 좌표계로 변환하여 비교했다.

실험 목표로 선정한 구조물은 3층 높이의 직사각형 형태를 갖고 있는 박스형 건축물이다(Figure 5 (a)). 이 구조물의 BIM 모델로부터 3D 형상 정보를 가져와 가상 구조물 구현에 활용했다(Figure 5 (b)). 구조물의 표면에 임의의 지점 26개를 설정하고, TLS를 통해 해당 지점들의 좌표를 획득했다. 26개 지점 중에서 평평한 면에 배치된 10개 지점을 외관 손상 위치로 가정하여 제안된 방법과의 비교에 활용했고, 나머지 지점들 일부는 가상 구조물의 배치에 활용했다. 구조물 배치 과정에서는 3D similarity transformation 계산을 통해 이것을 최소화하는 최적 배치를 찾아 적용했다.

구조물의 외관 손상은 위에서 설명한 바와 같이 외관 손상이 발생하여 성공적으로 탐지되었음을 가정하고 실험을 진행했다. 외관 손상의 위치들은 목표 구조물에서 가장 넓고 평평한 면에 배치될 수 있도록 Figure 5 (a)에서 보이는 구조물의 좌측면과 그 반대편에 배치했다. 각 점들 사이에 적절한 간격을 확보하기 위해 각 면에 5개씩 총 10개 지점을 배치했다.

실험에 사용된 UAV 기체는 DJI의 M210 RTK 모델로, RTK를 지원하여 cm 단위의 GNSS 정확도를 확보할 수 있는 모델이다. 장착된 카메라는 같은 제조사의 Zenmuse X5s, 렌즈는 DJI MFT 15mm/1.7 ASPH 모델을 사용했다. 이미지 센서의 크기, 초점거리와 같은 기기 사양에 관한 정보는 해당 제조사에서 제공하는 문서 등을 통해 확인할 수 있다. 매 실험마다 동일한 경로로 이동하고, 동일한 위치에서 이미지 촬영을 진행할 수 있도록 비행 계획을 수립하여 조종자 개입 없이 자동 비행으로 기체를 운영했다. 10개의 손상 지점에 대해서 각 지점당 5장의 이미지 촬영을 진행하여 1회 실험당 총 50장의 이미지를 획득했다. 총 50장의 외관 손상 이미지와 그에 해당하는 기체의 메타데이터가 함께 기체에 저장되고, 비행을 마친 후 이 데이터들을 토대로 PC에서 가상 공간을 구성하여 계산을 수행했다. 가상 공간 구현을 위해서 Unity engine을 사용했다.

3.2 실험 결과 및 오차 원인

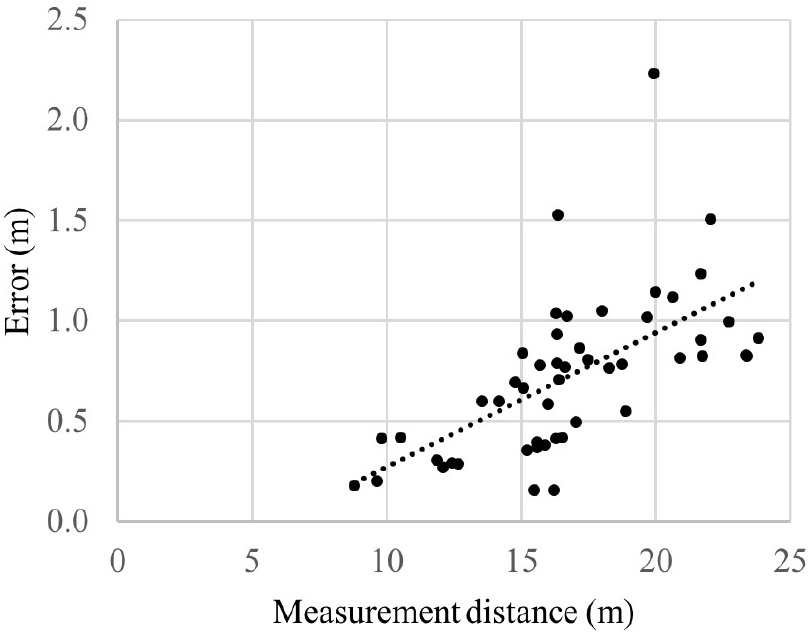

본 연구에서 제안하는 UAV, BIM 기반 위치 측정 방법의 목표 지점들의 계산 결과는 투영좌표계인 UTM을 기준으로 m 단위로 계산된다. 아래의 Table 1은 계산을 통해 추정된 결과와 TLS로 실측된 결과의 오차를 나타낸 것이다. 앞에서 설명한 바와 같이 총 10개 목표 지점에 대해 각 지점당 5장씩 총 50장의 이미지를 획득했다. 따라서 표에서는 각 지점별(ID)로 평균 오차를 나타냈다. 전체 평균 오차 0.728m, 표준편차 0.394m로, 1m 이하의 정확도를 갖는 것으로 나타났다.

Table 1.

The result of the experiment

다양한 오차 원인이 예상된다. 가장 먼저, 측정 장비로부터 기인할 수 있는 기기 오차가 있다. 데이터 수집 과정에서 UAV의 각종 센서들에서 발생한 오차이다. GNSS, IMU에서 발생하는 데이터들은 모두 오차를 포함하고 있다. 본 연구에서 활용한 장비에 탑재된 GNSS는 cm 단위의 정확도를 갖고 있으나 비행 시간이 지속되면서 오차가 누적될 수 있다. IMU의 경우, 특히 UAV가 바라보는 방향을 파악하는데 사용하는 자기 센서의 경우엔 쉽게 교란될 수 있는 특성을 가지고 있다. 본 연구에 있어서는 이러한 기기 오차들이 가장 지배적일 것으로 예상하고 있다.

다음은 측정 방법에서 기인할 수 있는 오차로, 수집한 데이터들로부터 3차원 위치를 추정하는 과정에서 발생할 수 있는 오차들이다. 첫 번째는 측정 지점의 픽셀 좌표를 획득하는 과정에서 발생할 수 있는 오차이다. 디지털 이미지를 활용하기 때문에 목표 지점의 좌표는 픽셀로 표현되며 이에 따라 GSD (Ground Sampling Distance)의 한계로 인한 오차가 발생할 수 있다. 실험에 사용된 UAV 카메라의 해상도는 5,280×3,956이고, 센서 사이즈는 17.3mm, 초점거리는 15mm이다. 정사영상을 가정하여 계산하면 100m에서 2.18cm/pixel의 GSD를 갖는 것을 확인할 수 있다. 실험에서는 50장의 이미지가 각각 다른 위치에서 촬영되어 측정 지점까지의 거리 또한 각각 다른 값을 갖는다. 측정 지점까지의 거리는 최소 8.80m에서 최대 23.80m까지 다양하며 평균 16.80m이다. 이에 근접한 15m에서의 GSD는 0.33cm/pixel이며 최대 거리인 25m에서는 0.55cm/pixel이다. 실제 실험 환경은 정사영상이 아니기 때문에 오차가 더 증폭될 수 있지만 이를 감안해도 GSD로 인한 오차는 전체 오차에 대한 영향이 크지는 않을 것으로 보인다. 두 번째는 이미지 왜곡에 따른 오차이다. 렌즈의 굴절률에 의해 발생할 수 있는 방사 왜곡(Radial distortion)은 이미지 중심으로부터 방사 형태의 왜곡 분포를 갖기 때문에 이미지 중심에서 벗어날수록 왜곡으로 인한 픽셀 측정 오차가 커질 수 있다. 세 번째는 가상 구조물로 인해 발생할 수 있는 오차다. 가상 공간에 배치된 가상 구조물은 실제 대상 구조물의 형상을 최대한 반영한 BIM 모델로부터 가져온 형상 정보를 이용하여 생성되었지만 실제 구조물의 형상을 완벽하게 반영하지는 못한다. 또한, 이 가상 구조물을 배치하는 과정에서도 오차가 발생할 수 있다. 위에서 언급한 바와 같이 TLS를 통해 측정된 위치 정보를 기반으로 3D similarity transformation 최적화를 통해 구조물이 배치되었다. 계산에는 총 10개의 지점이 사용되었으며 계산 결과에 따라 구조물을 회전 및 이동 배치하여 최종적으로 계산된 RMSE는 X(동)에 대해 0.056m, Y(북)에 대해 0.055m, Z(고도)에 대해 0.308m였다. 배치된 모델의 고도 오차가 상대적으로 매우 크게 나타났으나 실제 측정은 구조물의 북쪽, 남쪽 방향 평면을 대상으로만 진행되었기 때문에 고도 오차로 인한 영향은 훨씬 더 축소될 수 있다.

또한, 위의 모든 오차들은 카메라 평면이 구조물 평면과 이루는 각도, 측정 지점까지의 거리가 커질수록 증폭되는 특성을 갖는다(Figure 6). 따라서, 오차를 줄이기 위해서는 너무 멀거나 정면에서 벗어난 사선에서 이미지를 촬영하지 않는 것이 좋다.

3.3 오차 보정

UAV의 IMU와 카메라의 짐벌의 센서들은 비행이 시작될 때 캘리브레이션을 통해 초기화 과정을 거치지만 비행 중에 누적되는 오차들에 대해서는 추가적인 보정 처리가 필요하다. 각각의 센서들로부터 발생하는 오차들을 전부 분리하여 다룰 필요가 있으나 그에 앞서 간단한 방법으로 오차 보정을 시도했다. IMU와 짐벌 센서들은 주로 회전에 관여하고 있으므로 기체 및 카메라의 회전에 대해서만 보정 작업을 수행해도 오차를 완화할 수 있을 것으로 예상했다. 가장 먼저, 오차 보정을 위한 초기화 과정이 필요하다. 초기화 과정에서는 오차 보정을 위한 평균 오차를 수집한다. Figure 7은 본 연구에 적용한 오차 보정 방법을 설명하기 위한 예시이다. 본 연구에서 제안하는 측위 방법을 통해 추정 위치를 계산하는 과정에서 카메라로부터 추정 위치로의 벡터(Figure 4의 CT`에 해당)가 계산된다. 추정 위치에 해당하는 실제 목표 기지점의 3차원 위치를 알고 있다면 카메라로부터 해당 기지점으로의 벡터 또한 계산할 수 있다. 이러한 두 벡터 간에는 회전 오차가 존재한다. 동일한 기지점에 대해 위의 과정을 여러 차례 수행하여 그에 해당하는 회전 오차들을 계산한다. 이 값들을 평균하는 과정을 오차 보정 초기화라 하고, 평균값을 평균 회전 오차라 한다. 이후 매 측위 과정이 수행될 때마다 카메라 벡터에 대해서 평균 회전 오차만큼을 제하고 계산을 진행한다.

해당 오차 보정 방법을 적용한 측위 결과는 Table 2와 같다. 각 지점별 오차 변화를 살펴보면 전반적으로 오차가 감소하여 10개 지점 측위 평균 3차원 거리에 대하여 0.17m의 오차 감소 효과를 확인할 수 있다. 하지만 4, 5번 지점과 같이 오히려 오차가 증가하는 경우도 확인할 수 있다. 해당 지점들에 대한 기존 계산 결과가 3차원 거리 기준 0.3m 이하로 평균에 비해 매우 정확한 위치 정확도를 갖는 것으로 나타난 데이터들이기 때문에 일괄 적용하는 오차 보정 방식이 적합하지 않았던 것으로 예상된다. 이러한 점을 개선하기 위해 추후에는 각 데이터의 특성을 고려한 개별 오차 보정 방법을 적용해 볼 필요가 있다.

Table 2.

Comparison table of error correction

4. 결론 및 향후 연구

본 연구에서는 구조물 외관 조사 과정에서 활용될 수 있는 측위 기술에 대해 다루었다. 구조물 외관 조사의 필요성이 높아지고, 이를 자동화, 전산화하기 위한 다양한 시도들이 이루어지고 있으며 그 중에서 가장 널리 사용되고 있는 것이 UAV와 컴퓨터 비전 기술을 활용한 외관 조사 방법이다. 이 방법의 전체적인 수행 과정을 단계별로 나누어 볼 수 있으며 각 단계 중에서 이미지에서 탐지된 외관 손상의 위치를 측정하는 방법은 필수적인 과정이라 할 수 있다. 일반적인 사진측량 기반의 방법들은 측위를 위해서 동일한 목표물에 대해 다양한 위치에서 이미지를 촬영할 필요가 있으며 각 이미지의 공통된 특징점들을 서로 매칭해 줄 필요가 있다. 이러한 과정들은 다량의 데이터와 높은 연산량을 요구하기 때문에 규모가 큰 구조물을 대상으로 효율성이 떨어질 수 있으며 구조물의 국소 부위에 대한 외관 조사가 필요한 경우에 적합하지 않다는 한계가 있다. 또한, 측정에 필요한 마커나 기지점을 지속적으로 관리할 필요가 있다. 이러한 한계를 극복하기 위해 최근에는 깊이 카메라 혹은 레이저 거리측정기 등의 추가 센서를 부착하여 활용하기도 하지만 이 또한 추가적인 센서 부착으로 인해 UAV의 비행 효율이 저하될 수 있고, 센서 캘리브레이션이 필요하다는 한계를 갖고 있다.

본 연구에서는 이러한 점을 극복하고자 BIM 모델을 활용한 위치 측정 방법을 제안했다. UAV와 카메라 짐벌의 각종 GNSS, IMU 센서들로부터 확보한 데이터를 통해 가상 공간에서 카메라의 위치와 회전을 재구성하고, 실제 구조물의 BIM 모델의 형상 정보와 위치 정보를 이용하여 가상 공간에 가상 구조물을 재구성하여 재구성된 장면 내에서의 기하학적 관계에 따라 측위를 진행하는 방법이다.

실제 건축 구조물을 대상으로 실험을 진행했으며 실험을 통해 해당 방법의 활용 가능성을 확인했다. 본 연구에서 제안하는 방법으로 추정된 목표 지점들의 3차원 위치 좌표와 TLS를 통해 측정된 동일 지점들의 3차원 위치 좌표를 비교하여 정확도를 계산했으며 평균적으로 0.728m의 오차를 갖는 것으로 확인되었다.

다양한 오차 요인들이 있을 수 있으며 오차 보정 방법을 통해 UAV의 IMU와 카메라 짐벌에서 발생할 수 있는 회전 오차에 대해 보정을 시도했다. 오차 보정을 적용하지 않았을 때보다 약 0.17m의 3차원 거리 오차가 줄어든 것을 확인할 수 있었다. 하지만 기존 결과가 좋았던 경우에 대해서는 오히려 오차가 늘어나는 경우도 발생했다. 각 이미지 데이터의 수집 당시 상황과 데이터 특성을 고려하지 않고 발생 오차의 평균을 일괄 적용하는 오차 보정 방식의 문제로 생각된다. 이러한 점을 개선하기 위한 개별 오차 보정 방식에 대한 후속 연구가 필요하다.

본 연구에서는 한 가지 방식의 오차 보정 방법만을 적용해 보았으나 예상되는 오차 발생 요인이 다양한 만큼 오차 보정 방법 또한 더 다양한 방식으로 시도해 볼 수 있을 것으로 기대한다. 후속 연구에서는 위에서 언급한 개별 오차 보정 방식뿐 아니라 예상이 가능한 여러 오차 요인들에 대해 확인하고, 검증하는 과정을 추가 진행할 예정이다. 특히 가장 영향력이 큰 것으로 예상되는 회전 오차에 대하여 UAV IMU, 카메라 짐벌에 포함된 각 센서들의 오차를 하나씩 확인 검증하여 개선 방안을 모색하고자 한다. 더 다양한 형태의 구조물들에 대해 적용할 수 있도록 여러 형태를 가진 구조물을 대상으로 선정하여 본 연구에서 제안하는 측위 방법의 범용성을 넓혀갈 계획이다. 추가적으로 가상 공간에서의 대상 구조물 배치 과정에서 현재 사용되고 있는 좌표 체계 기반의 배치 방법 대신 UAV 카메라 시점 기반의 배치 방법을 적용한다면 UAV의 센싱 오차와 구조물 배치 오차 등의 다양한 오차 원인들을 배제할 수 있을 것으로 기대하고, 이를 위한 연구 개발을 진행할 계획이다.