1. 서 론

1.1 연구의 배경 및 목적

1.2 연구의 범위 및 방법

2. 기존 관련 연구 고찰

2.1 GAN의 원리와 응용

2.2 디자인 분야에서 GAN의 활용

2.3 인테리어 분야에서 딥러닝의 활용

2.4 본 연구에서의 차별성

3. 이미지 데이터 구축과 CycleGAN 제작

3.1 인테리어 스타일 분류

3.2 CycleGAN 모델 제작

4. 이미지 학습 및 결과

4.1 CycleGAN 모델 학습

4.2 학습 결과

5. 결론 및 제언

1. 서 론

1.1 연구의 배경 및 목적

최근 라이프스타일의 변화, 1인 가구의 증가로 인해 가구와 조명, 벽지, 침구 등 인테리어 소품으로 집안을 꾸미는 홈퍼니싱(Home Furnishing) 관련 산업이 주목받고 있다. 홈퍼니싱 시장은 꾸준히 성장하고 있으며, 2008년 7조 원에 그쳤던 시장 규모는 2015년 12조 원, 2016년 13조 1,000억 원 성장을 넘어 2023년에는 18조 원까지 폭발적으로 성장할 것으로 전망된다(Kim, 2018). 홈퍼니싱은 자신이 원하는 스타일과 방법으로 집을 꾸밀 수 있다는 큰 장점이 있다. 기존 홈퍼니싱 시장의 경우 사례 이미지를 바탕으로 자신의 공간을 새롭게 디자인해야 한다. 하지만 이 경우 시공하고자 하는 공간의 전, 후 모습을 직접 비교, 예측하기 쉽지 않으며 이 과정에서 시행착오로 낭비되는 시간과 재화가 발생할 수 있다.

딥러닝은 최근 다양한 분야에서 예측, 생성에 활용되는 알고리즘이다. 이 중 GAN(Generative Adversarial Networks)은 최근 활발히 연구되는 딥러닝 알고리즘 중 하나로서 원 데이터가 가진 확률분포를 추정하게 하여 인공신경망이 그 분포를 만들어내도록 하는 비지도 학습(Unsupervised learning)의 일종이다. 이미지 분야에서는 이미지 생성, 변환에 주로 사용되고 있으며, 특히 이 중 CycleGAN (Zhu et al., 2017)의 경우 입력 이미지를 다른 형태로 변환하여 출력할 수 있다. 그림의 스타일을 변환하거나, 계절별 풍경 이미지를 바꾸거나, 흑백 이미지를 컬러 이미지로 복원하는 등 다양한 분야에서 활용할 수 있다.

따라서 본 연구는 CycleGAN 모델에 스타일별로 분류한 실내 이미지를 학습시키고 테스트 이미지의 스타일을 변환하는 것을 목표로 한다. 이를 위해 특정한 조건(거실, 1점 투시, 창문 뷰)을 만족하는 인테리어 이미지를 웹사이트를 통해 수집하고, 수집된 이미지들을 기준에 맞게 분류한다. 분류된 이미지 데이터를 CycleGAN 알고리즘을 통해 스타일 별 형태와 패턴을 학습시킨다. 이를 통해 이용자는 단순히 이미지 촬영으로 데이터 세트에서 학습한 스타일 별 특징을 적용해볼 수 있다. 앞으로 홈퍼니싱 시장에서 개인이 원하는 스타일을 빠르게 적용해보고 전, 후 모습을 비교해봄으로써 시행착오를 줄일 수 있는 기술이 될 것이다.

1.2 연구의 범위 및 방법

본 연구는 CycleGAN 모델이 스타일별 이미지의 특성을 분명히 파악하기 위해 실내 디자인 스타일을 명확하게 규정하였으며, 이를 통해 딥러닝을 통한 실내 이미지 변환의 활용 가능성을 고찰하고자 한다. 먼저 연구 대상 이미지는 거실, 1점 투시. 창문과 베란다 뷰의 조건으로 한정한다. 실내 디자인 스타일은 많은 선행연구에서 공통으로 제시한 3가지 유형의 스타일(모던, 클래식, 내추럴)로 한정한다. 실내 이미지 변환 모델에 사용한 CycleGAN의 생성자 신경망 구조로 ResNet, UNet 2가지를 구현하고 비교한다. CycleGAN의 원리와 구조를 간단히 서술하고, 구현 결과와 활용 방안 제시에 초점을 둔다.

본 연구의 방법은 다음과 같다.

첫째, 조건을 만족하는 실제 인테리어 이미지를 웹사이트를 통해 수집하고, 이를 선행연구를 통해 수립한 기준에 따라 3가지 스타일로 분류한다.

둘째, 실내 인테리어 이미지를 정방형의 Tensor 형태로 변환하고, 학습을 위한 Training Set과 검증을 위한 Test Set을 구축한다.

셋째, 변환 스타일, 신경망 구조에 따라 CycleGAN 모형을 구현하고, Training Set의 이미지를 학습시킨다.

넷째, Hyperparameter Tuning을 통해 이미지 품질이 최적인 Hyperparameter 값을 찾는다.

다섯째, 학습된 변환 모델들을 통해 Test Set 이미지를 변환시키고 모델 간 성능과 품질을 비교한다.

2. 기존 관련 연구 고찰

2.1 GAN의 원리와 응용

GAN은 생성자(Generator)와 판별자(Discriminator)라는 두 종류의 신경망으로 구성된 알고리즘이며 두 신경망의 상호작용으로 학습한다. 생성자는 새로운 이미지를 생성하고 판별자는 진위를 판별하며, 이 과정을 반복, 서로 대립하며 높은 수준의 결과물을 생성한다. 기본적인 GAN의 문제를 해결하기 위해 구조, 조건, 목적함수 등이 향상된 다양한 GAN 모델이 개발되었다1). 먼저 CGAN(Conditional GAN), ACGAN(Auxiliary Classifier GAN)은 생성자에 제약조건(condition)이나 카테고리 레이블을 추가하여 원하는 결과물을 얻는 생성 모델이다. WGAN은 실제 샘플과 생성된 샘플 사이의 Wasserstein distance을 통해 학습하는 모델이다.

이러한 기본적인 GAN을 응용하여 이미지 변환 (Image to Image Translation)을 수행할 수 있다. 이미지 변환을 수행하는 대표적인 알고리즘으로는 Pix2Pix, CycleGAN, StarGAN 등이 있다.

2.2 디자인 분야에서 GAN의 활용

GAN은 디자인 분야에서 마찬가지로 활용되었는데, 먼저 Pix2Pix를 활용하여 추상적으로 표현된 건축 스케치 이미지를 실체화된 이미지로 변환하는 연구가 수행되었다(Han and Shin, 2021). 또한, CycleGAN을 활용하여 흑백의 도시설계 도면을 렌더링 된 이미지로 변환하는 모델을 구축하였다(Ye et al., 2021). 그러나 선행연구의 경우 실제 이미지가 아닌 도면, 스케치 등을 변환하여 이들을 제작하기 어려운 비전문가가 활용하기 어렵다는 단점이 있다.

2.3 인테리어 분야에서 딥러닝의 활용

인테리어 분야에서도 딥러닝을 접목하려는 시도가 있었다. 먼저 스타일 별 인테리어 이미지 데이터를 구축한 다음 CNN 모델인 VGG16에 학습시켜 인테리어 스타일을 인식하는 딥러닝 모델을 구축하였다(Kim and Lee, 2020). 또한, CNN 딥러닝 모델을 사용하여 병원 실내 이미지의 감성 어휘를 분류하고 실내 감성을 정량적으로 파악하였다(Chung and Lee, 2019). 이러한 연구들은 이미지 딥러닝 모델이 인테리어 이미지를 성공적으로 인식하고 분류할 수 있음을 보여주었다. 또한, 본 연구에서 사용하고자 하는 딥러닝 기반 이미지 변환 모델에도 인테리어 이미지를 활용할 수 있을 것으로 예상된다.

2.4 본 연구에서의 차별성

본 연구에서는 Image to Image Translation을 수행하는 대표적인 알고리즘인 CycleGAN을 활용하여 비전문가가 카메라를 통해 쉽게 얻을 수 있는 실제 이미지를 입력으로 하는 모델 개발을 목표로 하였다. 또한, 모델의 출력 역시 스타일이 변환된 이미지로 실사와 근접하도록 하였다. 딥러닝 인공지능으로 새로운 실내 이미지를 생성하여, 인테리어 분야에서 딥러닝 모델 활용을 확장하는 데 의의가 있다.

3. 이미지 데이터 구축과 CycleGAN 제작

3.1 인테리어 스타일 분류

실내 디자인 스타일은 디자인의 모든 요소가 결합하여 형성되는 전체적인 분위기와 실내 마감재의 종류, 형태, 색채가 복합되어 나타나는 공간의 특성이다(Min and Choi, 2014). 따라서 스타일을 분류하기 위해서는 다양한 구성요소(바닥, 벽, 천장, 문, 가구, 조명 등)를 살펴보아야 하며, 객관적으로 존재하는 흐름이나 경향이 형성되어야 한다. 따라서 모던, 클래식, 내추럴 3가지 스타일에 대해 분류 기준을 참고하여, 이를 Table 1로 정리하였다(Han and Lee, 2002; Lee and Ko, 2011; Min and Choi, 2014). Figure 1은 스타일별로 선정한 대표 이미지들이며, 조건을 만족하지 않는 이미지는 삭제하였다. 최종적으로 수집한 실사 이미지는 Modern 340개, Classic 253개, Natural 254개이며, 스타일마다 240개의 이미지를 Training set으로, 나머지 이미지를 Test set으로 활용하였다.

Table 1.

Style classification standard by components

3.2 CycleGAN 모델 제작

1.3.3 품질검토 SW 현황 및 분석

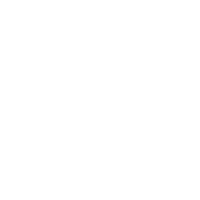

CycleGAN은 Image to Image Translation에 널리 활용하는 대표적인 조건부 적대적 신경망이다. CycleGAN의 장점은 이전에 개발된 pix2pix와 다르게 짝지어진 이미지를 쓰지 않아도 된다는 점이다. 따라서 실사 이미지를 대상으로 하면 각각의 스타일에 대해 쉽게 데이터 세트를 구할 수 있다. CycleGAN의 아키텍처는 Figure 2에 정리하였다. CycleGAN 알고리즘은 도메인 A에서 B로 변환하는 생성자, 도메인 B에서 A로 변환하는 생성자, 도메인 A 이미지를 구별하는 판별자, 도메인 B 이미지를 구별하는 판별자 총 4개의 신경망으로 구성되어 있다.

CycleGAN은 Cycle-Consistency의 개념이 추가되었으며, 이는 도메인 A 이미지를 도메인 B로 변환하였다가 다시 도메인 A로 변환하면 이상적으로 원본 이미지와 동일해야 한다는 개념이다. 판별자가 변환된 이미지와 원본 이미지를 구별한 결과에 Cycle-Consistency 요소를 더해 최종 목적함수(Object function)를 계산하며, 이를 최적화하며 신경망의 학습이 진행된다. 학습이 완료되면 최종적으로 각각의 다른 스타일로 이미지를 변환하는 2개의 생성자를 얻어 활용할 수 있다. 이 과정은 Python 언어의 구글 Tensorflow 패키지를 이용하여 진행하였다.

3.2.2 생성자 신경망의 구조 : ResNet과 UNet

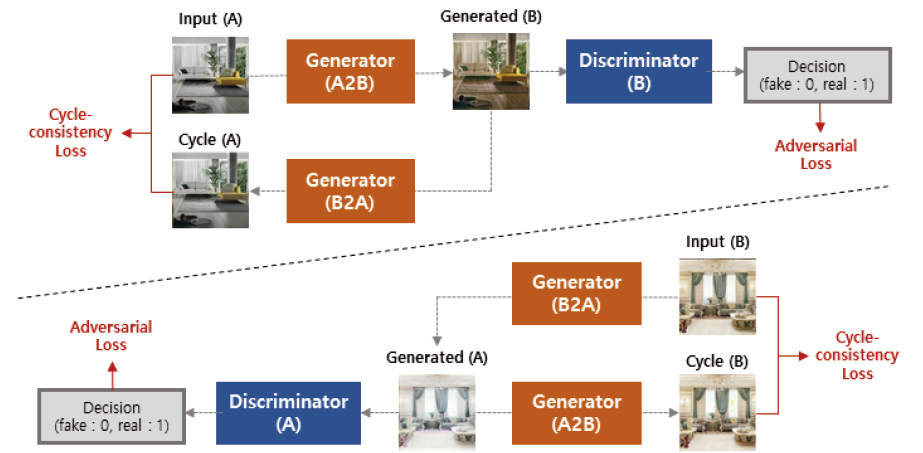

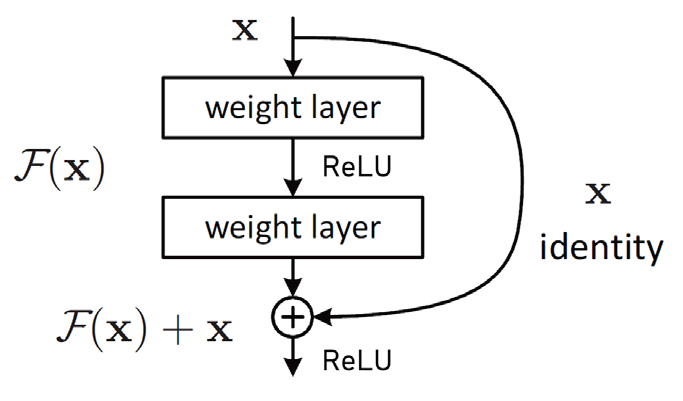

CycleGAN의 생성자와 판별자 모델 구조는 프로그래밍을 통해 자유롭게 바꿀 수 있으며, 생성자 신경망 구조로 이미지 변환에 많이 활용하는 ResNet, UNet을 사용하고 비교하였다. ResNet은 Residual Block을 적용한 신경망이며, 층을 건너뛰는 덧셈 연결을 통해 깊은 인공신경망에서 학습을 원활하게 하는 구조이다(Figure 3). Residual Block의 덧셈 연결망은 출력 이미지가 입력 이미지와 같은 구조를 공유하도록 하므로 이미지 변환에 적합하다(Johnson et al., 2016) ResNet은 크게 다운 샘플링을 진행하는 인코더(Encoder), Residual Block으로 구성된 변환기(Transformer), 다시 업샘플링을 진행하는 디코더(Decoder)로 구성되어 있다. 인코더와 디코더 부분이 얕으므로 물체를 정확하게 인식하는 데에는 단점이 될 수 있으며, 물체 이외의 부분에서 변형이 발생할 수 있다(Kim and Park, 2018).

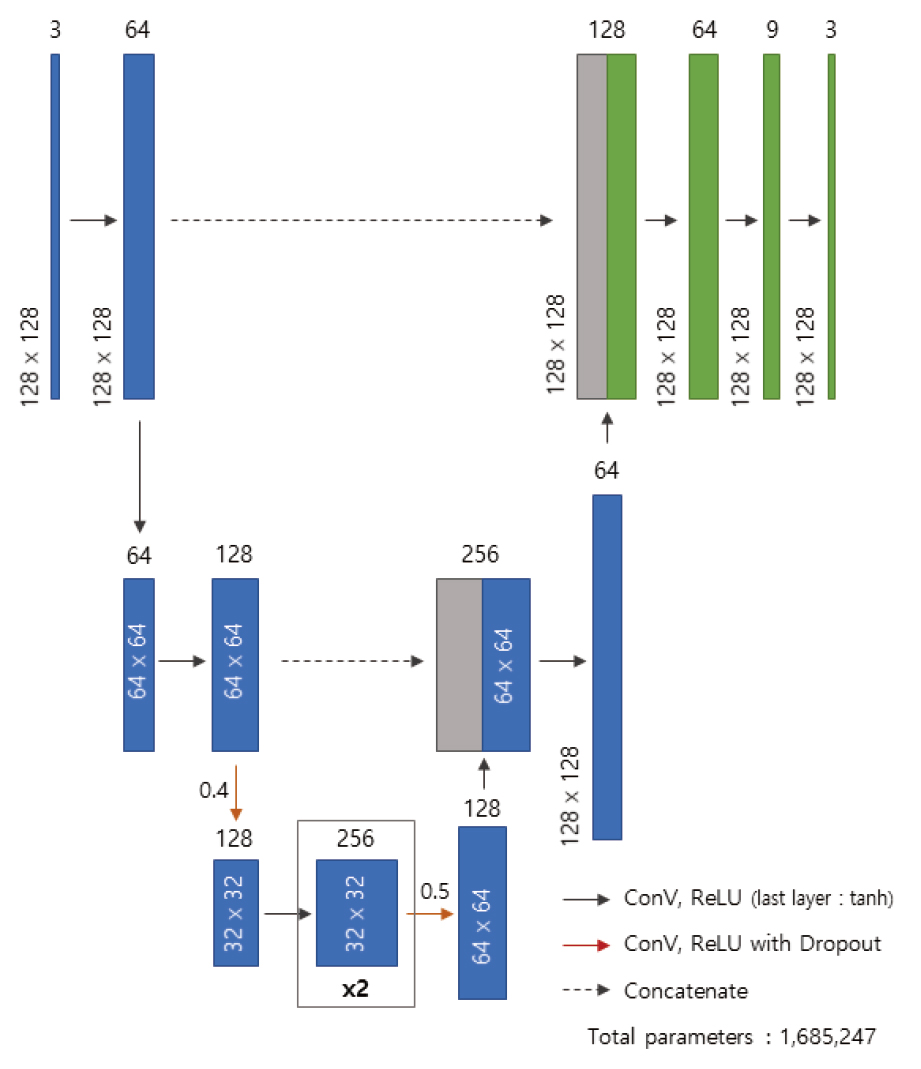

UNet은 이미지 변환과 이미지 분할(Image Segmentation)에 많이 활용하는 신경망 구조이며 의료 영상 분야에 많이 활용한다. 이는 정확한 공간정보를 전달하기 위해 인코더 부분과 디코더 부분 사이에 연결을 추가한 구조로 되어 있다. 따라서 더 깊은 층의 인코더와 디코더를 쌓을 수 있다. UNet은 고해상도 형상을 잘 보존하며, 물체의 경계와 질감 역시 효과적으로 인식한다(Sun et al., 2019). 각 신경망의 구조는 Figure 4, 5에 자세히 기술하였다.

3.2.3 손실함수(Loss function)와 Gradient penalty

초기 CycleGAN에서는 3가지 Loss function(Adversarial Loss, Cycle-consistency Loss, Identity Loss)을 수식화하고 더하여 최적화할 전체 목적함수를 제안하였다(Zhu et al., 2017). 먼저 생성자와 판별자의 적대적인 경쟁을 위해 최적화하고자 하는 Adversarial Loss는 식 1과 같으며, 학습의 안정성과 실패 방지를 위하여 CycleGAN에 Least-square loss function을 사용하였다.

여기서 생성자가 생성한 가짜 이미지 를 받아 판별자 가 진위를 판별하게 된다. 또한, 판별자는 실제 이미지를 입력받아 진위를 판별하고, 이러한 결과로 계산된 Adversarial Loss Function을 바탕으로 더 정확한 예측을 하도록 가중치를 조절한다. 반면에 생성자는 판별자를 속일 수 있는 이미지를 생성하도록 가중치를 조절한다. 두 도메인이 존재하므로 Adversarial Loss는 와 2가지가 존재한다.

다음으로 Cycle-consistency Loss는 다른 도메인으로 변환한 이미지를 다시 원래 도메인 이미지로 변환할 때, 원본 이미지와의 차이를 계산하며 식 2와 같다.

Identity Loss는 생성자에 변환해야 할 도메인이 아닌 다른 도메인의 이미지가 들어올 경우, 원본 이미지를 산출하기 위해 도입되었으며 식 3과 같다.

마지막으로 3가지 Loss 외에도 Gradient penalty(Liu, 2021)를 더함으로써 기울기(Gradient)가 사라지는 것을 방지하고, 학습 과정에서 일정 범위의 값을 유지할 수 있다.

따라서 전체 목적함수는 식 6과 같다.

가중치 , 를 조절함으로써 각 손실함수의 영향을 정할 수 있으며, 최적의 가중치를 탐색하였다. 본 모델에서는 = 8.5, = 0.5, = 0.5의 값을 사용하였다.

4. 이미지 학습 및 결과

4.1 CycleGAN 모델 학습

먼저 실내 인테리어 이미지는 크기 증가로 학습 시간이 과도하게 길어지지 않으면서 소품, 패턴 등을 인지할 수 있는 128*128픽셀 크기의 정방형 이미지로 변환하였다. 이미지들은 한 학습 과정에서 총 4가지로 분류하였으며(training A, training B, test A, test B), 각 경우에 대해 모델이 인식할 수 있는 4차원 tensor 형태의 데이터 세트로 변환하였다. Tensor가 4차원인 이유는 각각 이미지 개수, 가로 픽셀, 세로 픽셀, RGB channel 차원을 포함하고 있기 때문이다. 이후 신경망과 손실함수, 최적화 알고리즘(Optimizer)을 선언한 후 학습을 진행하였다. 데이터 세트 전체를 학습하는 횟수인 Epoch는 Loss가 어느 정도 수렴하고 충분히 학습되었다고 판단된 150으로 설정하였으며, 학습률(Learning rate), 손실함수 요소별(Cycle-consistency loss, Adversarial Loss, Gradient penalty) 가중치 등을 조절하여 최적의 결과를 찾아내는 Hyperparameter Tuning을 진행하였다. 본 연구에서 활용한 ADAM Optimizer의 hyperparameter 값은 learning rate = 0.0002, beta1 = 0.5 값을 사용하였다.

이 과정을 스타일 짝별로(모던-내추럴, 모던-클래식), 생성자 신경망 구조별로(ResNet, UNet) 총 4회 반복하였다.

4.2 학습 결과

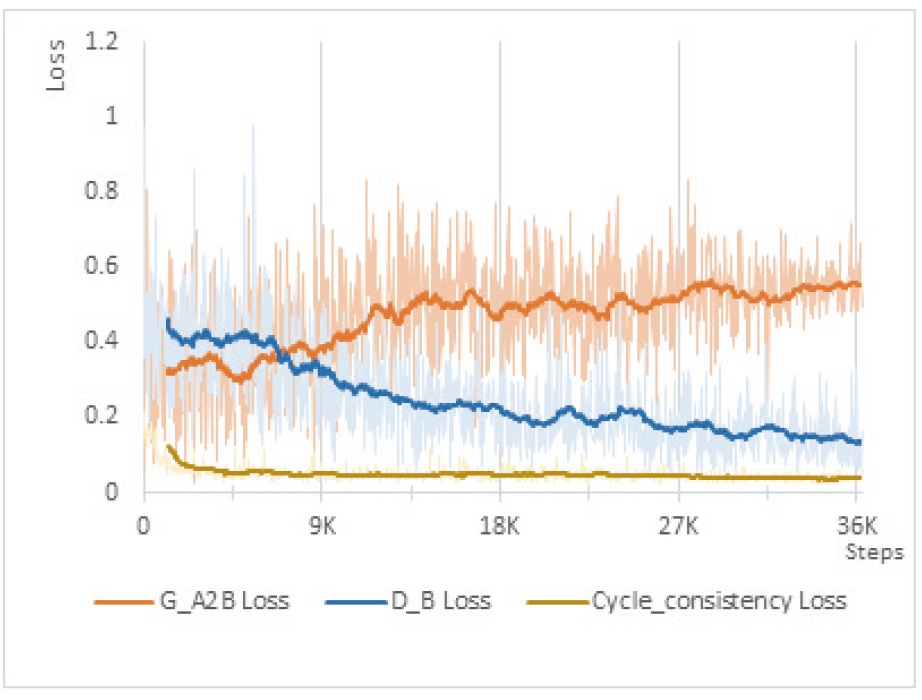

Figure 6은 학습을 진행하면서 생성자, 판별자의 Loss와 Cycle_consistency Loss의 변화를 그래프로 나타낸 것이다. 생성자와 판별자의 loss가 주기적으로 진동하거나 0, 1로 수렴하지 않고, 일정 범위 내에서 움직이며 적대적인 경쟁 학습이 정상적으로 진행되었다.

Figure 7, 8, 9, 10은 각 경우에 대해 CycleGAN 학습을 진행하고, Test set의 이미지 데이터(좌)를 학습된 생성자를 통해 스타일을 변환한(우) 결과물이다. 전체적으로 모던한 분위기의 무채색 색상을 인지하여 내추럴, 클래식 등 다른 스타일의 색상으로 변환하는 것을 확인할 수 있었다. 바닥, 벽, 가구 등 공통으로 나타나는 실내 이미지 요소를 각각 파악하고, 이에 따라 적합한 색상과 재질을 다르게 변환함으로써 인테리어 스타일에 따라 전체적인 분위기를 형성하였다. 특히 모던-내추럴 변환 모델에서는 바닥의 경계부를 정확히 인식하였으며 선명한 목재 재질 혹은 무채색 바닥으로 변환하여 자재 마감에 대해 높은 예측력을 나타내었다. 전체적인 분위기와 색상은 잘 변환하였으나 가구의 형태와 장식, 상세한 패턴 등 모양, 형태에 관한 부분은 예측력이 상대적으로 부족했다. 하지만 인테리어 스타일의 각 요소가 이미지에서 차지하는 영역을 지정하지 않고 기존의 사례 이미지만으로 재질, 색상을 자동으로 투영한다는 점에서 의의가 있다.

ResNet과 UNet을 비교하였을 때 UNet이 상대적으로 색상, 재질 변환에 있어서 더 과격한 모습을 보여주었다. 또한 식재 등 실내의 주조색과 다른 색상을 가진 요소를 잘 파악하여 보존하였다. 하지만 UNet의 경우 얼룩짐 현상이 발생하였으며, 변환에 실패하는 사례도 많아 향후 UNet과 ResNet을 복합한 생성자 신경망을 구축하여 실험할 필요가 있다.

5. 결론 및 제언

본 연구에서는 GAN의 대표적인 알고리즘인 CycleGAN을 인테리어 이미지에 적용하고 최종적으로 이미지 스타일 변환을 시도하였다. 원하는 실내 이미지의 구성요소를 파악하고 요소별로 변환하고자 하는 스타일의 색상과 재질을 예측할 수 있으며 전체적인 분위기를 변환시킬 수 있었다. 이를 통해 시공하고자 하는 실내 공간 스타일의 전·후 모습을 빠르고 간편하게 시각화하고 비교할 수 있다. 이는 건물 정보 모델의 렌더링 과정에서도 활용할 수 있으며, 여러 스타일 별 View를 material 변경 없이 생성하여 인테리어 대안 제시 과정의 시간적 비용을 절감할 수 있다. 하지만, 색상과 재질 외에 가구의 형태, 장식물, 세밀한 패턴 표현 등은 인공지능이 명확하게 인지하기 상대적으로 힘들며, 이런 부분에서 품질 향상이 필요하다.

연구 과정에서 수집한 이미지 데이터의 경우 스타일, 구도를 엄격히 제한하였기 때문에 적은 이미지로 학습시켜 정확성이 떨어질 수 있다는 한계점이 존재하였다. 하지만 CycleGAN 이미지의 경우 형태는 같고 스타일이 다른 pair 이미지가 필요 없으므로 학습용 이미지를 별다른 변환 과정 없이 구할 수 있다. 현재 여러 온라인 셀프 인테리어 플랫폼이 등장하고 있으며, 이에 따라 사례 이미지 수는 계속 증가할 것으로 보인다. 다양한 스타일, 구도의 인테리어 사진을 대량 수집한다면, 더 높은 품질로 시각화할 수 있다는 가능성을 보여주었다.

CycleGAN 모델에도 한계점은 존재한다. 먼저 CycleGAN은 2개의 도메인만을 변환할 수 있으므로 3개 이상의 스타일을 변환하면 2개씩 짝지어진 쌍에 대해 각각 모델을 따로 학습시켜야 한다는 한계점이 있다. 따라서 스타일의 종류가 증가하면 모델의 개수 역시 기하급수적으로 증가한다. 향후 연구에서는 한 모델에서 다양한 도메인으로 이미지를 변환시킬 수 있는 StarGAN(Choi et al., 2018)을 활용할 수 있다. 또한, 시공 전·후 모습을 비교할 때 새로운 가구를 배치할 수 없다는 단점 역시 존재하며, 이는 기하학적인 배치와 외관을 고려하여 가구 이미지를 배치하는 Adaptive Composition GAN(Zhan et al., 2019)을 활용할 수 있다.

본 연구를 통해 인테리어 이미지에 생성 모델인 CycleGAN을 접목하고 스타일 변환 용도로의 활용 가능성을 보여주었으며, 향후 개선점과 발전 방향을 도출하였다. 후속 연구를 통해 GAN이 인테리어 및 디자인 렌더링에 전반적으로 활용될 수 있을 것이다.